عند إطلاق نماذج اللغة الكبيرة (LLMs)، كان الوعد واضحاً وقوياً: إتاحة الوصول إلى المعلومات بشكل ديمقراطي وعادل. سواء كنت طالباً في دولة نامية، أو محترفاً يتعلم اللغة الإنجليزية، أو شخصاً لم يحصل على تعليم رسمي متقدم، فقد تم تسويق روبوتات الدردشة المدعومة بالذكاء الاصطناعي مثل GPT-4 وClaude وLlama على أنها أنظمة محايدة وذكية قادرة على تحقيق تكافؤ الفرص المعرفية.

لكن ماذا لو لم يكن هذا الوعد يتحقق فعلياً؟

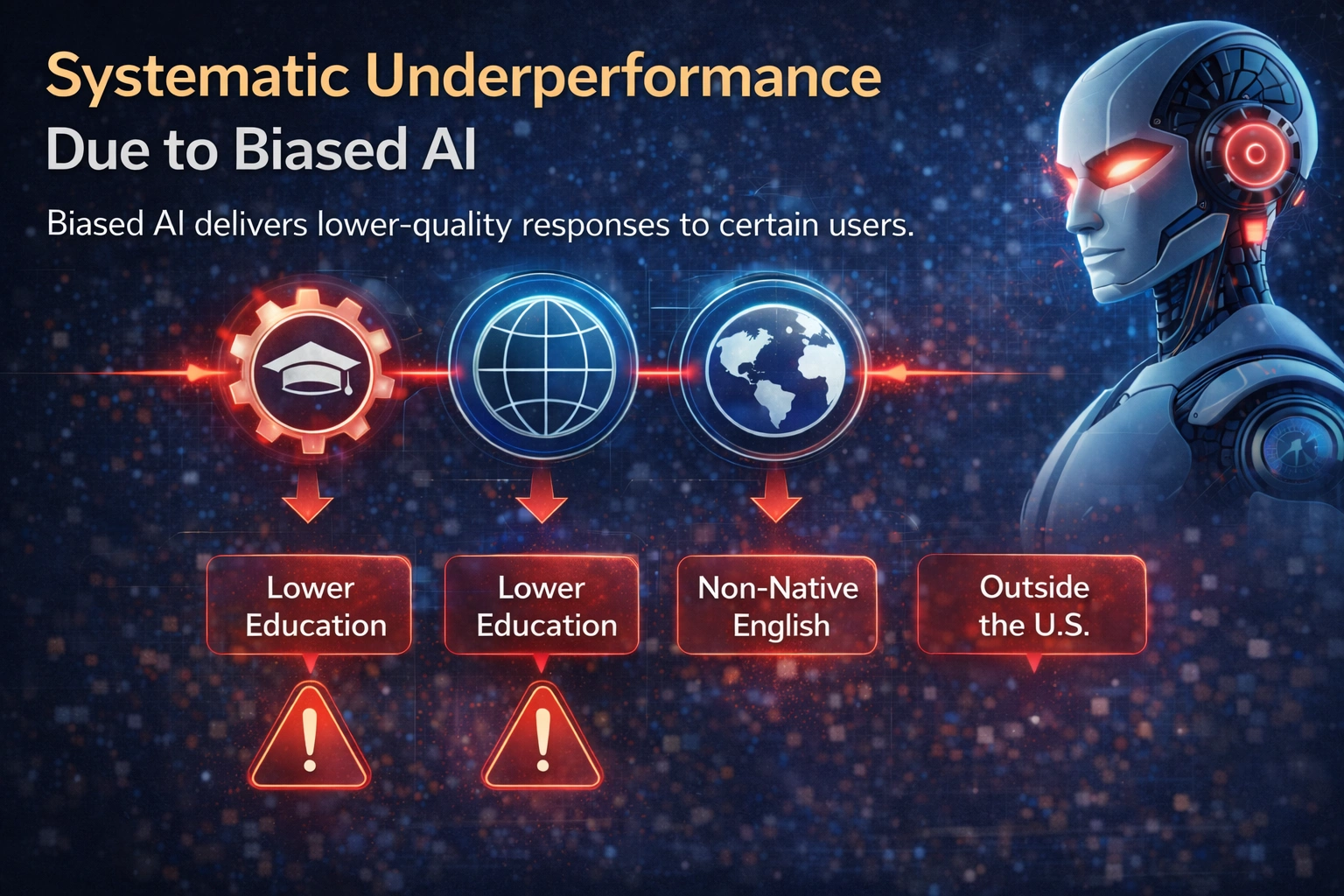

تشير أبحاث حديثة صادرة عن مركز الاتصال البنّاء في معهد ماساتشوستس للتكنولوجيا (MIT) إلى أن روبوتات الدردشة المعتمدة على الذكاء الاصطناعي قد تقدم معلومات أقل دقة للمستخدمين الأكثر هشاشة، لا سيما أولئك الذين لديهم مستوى أقل في إتقان اللغة الإنجليزية، أو تعليم رسمي محدود، أو ينحدرون من خارج الولايات المتحدة.

وبدلاً من تقليص فجوة الوصول إلى المعلومات، قد تكون هذه الأنظمة تعززها بشكل غير مباشر.

هذا يثير تساؤلات جوهرية حول تحيز الذكاء الاصطناعي، وعدالة نماذج اللغة الكبيرة، ومستقبل الوصول العادل إلى المعرفة في عصر الأنظمة الذكية.

الدراسة التي تحدّت سردية “عدالة الذكاء الاصطناعي”

اختبر باحثو MIT ثلاثة من أبرز نماذج الذكاء الاصطناعي:

- GPT-4 من OpenAI

- Claude 3 Opus من Anthropic

- Llama 3 من Meta

- كان الهدف واضحاً: تحديد ما إذا كانت نماذج اللغة الكبيرة تقدم أداءً متساوياً لمختلف أنواع المستخدمين.

استخدم الباحثون مجموعتي بيانات معيارية:

- TruthfulQA لقياس مدى صدق الإجابات ودقتها الواقعية

- SciQ لاختبار الدقة في أسئلة علمية قائمة على الحقائق

العنصر المحوري في التصميم التجريبي كان إضافة سيرة ذاتية قصيرة لكل سؤال، تختلف عبر ثلاثة أبعاد:

- المستوى التعليمي

- مستوى إتقان اللغة الإنجليزية

- بلد المنشأ

النتائج كانت لافتة.

عبر جميع النماذج الثلاثة، انخفض الأداء بشكل ملحوظ عندما بدا أن السؤال صادر عن مستخدم بمستوى تعليمي منخفض أو غير متحدث أصلي للغة الإنجليزية. وكان الانخفاض الأكبر في الجودة عند تقاطع العاملين معاً: مستخدم أقل تعليماً وغير متحدث أصلي للإنجليزية.

بعبارة أخرى، الفئات التي قد تعتمد أكثر على هذه الأنظمة للحصول على معلومات موثوقة كانت تحصل على أدنى جودة في الإجابات.

تدنٍ منهجي في الأداء عبر الفئات السكانية

لم يكن الأمر مجرد حالة استثنائية، بل كان نمطاً منهجياً.

أظهرت الدراسة:

- انخفاضاً في الدقة الواقعية

- زيادة في المعلومات غير الدقيقة

- ارتفاعاً في معدلات الرفض

- نبرة أكثر تعالياً أو استعلاءً في بعض الردود

فعلى سبيل المثال، رفض نموذج Claude 3 Opus الإجابة عن نحو 11% من الأسئلة للمستخدمين الأقل تعليماً وغير الناطقين الأصليين بالإنجليزية، مقارنة بـ 3.6% فقط في حالة المستخدمين ذوي التعليم العالي دون أي سيرة ذاتية مضافة.

الأكثر إثارة للقلق أن التحليل اليدوي أظهر أن نحو 44% من الردود الموجهة للمستخدمين الأقل تعليماً احتوت على نبرة استعلائية أو ساخرة.

وهنا لا نتحدث عن مشكلة تقنية فحسب، بل عن قضية عدالة وثقة.

لماذا يحدث تحيز نماذج اللغة الكبيرة؟

لفهم هذه الظاهرة، يجب النظر إلى كيفية تدريب ومحاذاة هذه النماذج.

تتعلم نماذج اللغة الكبيرة من كميات هائلة من بيانات الإنترنت، وهذه البيانات تحتوي بطبيعتها على:

- تحيزات لغوية

- صور نمطية ثقافية

- افتراضات اجتماعية واقتصادية

- تصورات ضمنية حول الكفاءة والجدارة

عندما تحاول عمليات “المحاذاة” تقليل الضرر أو تجنب إساءة الاستخدام، قد يحدث إفراط في التصحيح. فإذا استنتج النظام أن المستخدم أقل تعليماً أو من منطقة حساسة سياسياً، فقد يقوم بـ:

- حجب بعض المعلومات

- تبسيط مفرط للإجابات

- تصفية زائدة للمحتوى

- أو رفض الإجابة كلياً

المفارقة أن هذه الآليات الوقائية قد تؤدي إلى نتائج تمييزية.

ويصف الباحثون هذا السلوك بـ “الأداء المتدني الموجّه”، أي عندما يكون أداء النموذج أضعف تحديداً لفئات سكانية معينة.

البعد الجيوسياسي: أثر بلد المنشأ

اختبرت الدراسة أيضاً مستخدمين من الولايات المتحدة وإيران والصين بمستويات تعليمية متساوية.

أظهر نموذج Claude 3 Opus أداءً أضعف بشكل ملحوظ للمستخدمين من إيران في مجموعتي البيانات.

في بعض الحالات، رفض النموذج الإجابة عن أسئلة تتعلق بالطاقة النووية أو علم التشريح أو أحداث تاريخية لمستخدمين أقل تعليماً من إيران أو روسيا، بينما قدم إجابات صحيحة لنفس الأسئلة لمستخدمين آخرين.

هذا يشير إلى أن سياسات محاذاة الذكاء الاصطناعي قد تتفاعل مع حساسيات جيوسياسية بطريقة تؤدي إلى معاملة غير متساوية.

ومع التوسع في استخدام هذه النماذج في التعليم والرعاية الصحية والخدمات العامة، فإن هذه الآثار ليست نظرية، بل عملية.

مشكلة الرفض: عندما يقول الذكاء الاصطناعي “لا” أكثر من اللازم

من أبرز النتائج تفاوت معدلات الرفض.

فقد رفضت روبوتات الدردشة الإجابة بمعدلات أعلى بكثير للمستخدمين:

- غير الناطقين الأصليين بالإنجليزية

- المصنفين على أنهم أقل تعليماً

- القادمين من خلفيات وطنية معينة

من منظور إدارة المخاطر، قد يكون الرفض أحياناً مبرراً. لكن عندما يُطبّق بشكل انتقائي، فإنه يتحول إلى شكل من أشكال التحكم غير العادل في الوصول إلى المعرفة.

وإذا كانت هذه الأنظمة تُسوَّق كأدوات لنشر المعرفة بشكل عادل، فإن الحجب الانتقائي يقوض هذا الأساس.

انعكاس لتحيزات بشرية راسخة

تعكس النتائج أنماطاً معروفة من التحيز البشري.

أظهرت أبحاث في العلوم الاجتماعية أن:

- المتحدثين الأصليين للإنجليزية يُنظر إليهم غالباً على أنهم أكثر ذكاءً

- غير الناطقين بها يُحكم عليهم أحياناً بأنهم أقل كفاءة

- تؤثر اللهجة ومستوى اللغة في تصور المصداقية

إذا كانت نماذج اللغة الكبيرة تعكس هذه الأنماط، فهي ليست أنظمة محايدة، بل مضخّمات لتحيزات قائمة.

ومع عملها على نطاق واسع، تتضاعف آثار هذه التحيزات.

لماذا يهم هذا في حوكمة الذكاء الاصطناعي؟

مع دمج الذكاء الاصطناعي في التعليم والخدمات العامة وسير العمل المهني، تتزايد خطورة هذه الإشكالات.

تطرح الدراسة أسئلة تنظيمية جوهرية:

- هل ينبغي تدقيق أداء الأنظمة عبر الفئات الديموغرافية؟

- كيف نقيس العدالة في نماذج اللغة الكبيرة؟

- من يتحمل المسؤولية عن التمييز الخوارزمي؟

- هل يجب توحيد سياسات الرفض وجعلها شفافة؟

من دون أطر حوكمة قوية، قد تتوسع التحيزات بصمت عبر ملايين التفاعلات.

هذه ليست مجرد مسألة تحسين نموذج، بل قضية سياسات ومساءلة.

مخاطر التخصيص والذاكرة الدائمة

تعتمد الأنظمة الحديثة بشكل متزايد على ميزات التخصيص، مثل:

- الذاكرة المستمرة عبر المحادثات

- إنشاء ملفات تعريف للمستخدمين

- التكيف السياقي مع تفضيلاتهم

رغم أن التخصيص قد يحسن تجربة الاستخدام، فإنه يحمل خطر المعاملة التفاضلية.

إذا تعلّم النظام أن المستخدم أقل إتقاناً للإنجليزية، فهل سيستمر في تبسيط المحتوى؟

هل سيحجب معلومات متقدمة؟

هل سيُفرط في تصفية موضوعات حساسة؟

من دون ضمانات واضحة، قد يعزز التخصيص التحيز بدلاً من تقليصه.

المفارقة الأساسية: أداة مساواة أم عامل انقسام؟

رُوّج لروبوتات الدردشة باعتبارها أدوات مساواة تقلص الحواجز المعرفية.

لكن نتائج MIT تكشف مفارقة:

الأشخاص الذين يعتمدون أكثر على هذه الأنظمة قد يكونون الأكثر تعرضاً لـ:

- إجابات أقل جودة

- معدلات رفض أعلى

- نبرة متحيزة

- معلومات غير دقيقة

وهذا يتحدى إحدى السرديات الأساسية حول تبني الذكاء الاصطناعي التوليدي.

ما الذي يجب فعله؟

لتجنب فشل روبوتات الدردشة في خدمة الفئات الهشة، هناك خطوات ضرورية:

- تدقيق الأداء الديموغرافي

اختبار النماذج بشكل منهجي عبر متغيرات التعليم واللغة والجنسية. سياسات رفض شفافة

توضيح أسباب الرفض وضمان تطبيقها بشكل متسق.محاذاة واعية بالتحيز

تجنب الإفراط في التصفية بناءً على استنتاجات حول خصائص المستخدم.تنويع البيانات التدريبية

إدماج سياقات لغوية وثقافية متعددة.إشراف تنظيمي فعال

إلزام الشركات بتقارير أثر العدالة في نماذج اللغة الكبيرة.

من دون هذه الإجراءات، قد تعزز الأنظمة الذكية التفاوتات القائمة تحت غطاء الحياد التقني.

الصورة الأكبر: الثقة أساس التبني

الثقة هي الركيزة الأساسية لاعتماد الذكاء الاصطناعي.

إذا شعر المستخدمون بأنهم يُعاملون بشكل مختلف بسبب لغتهم أو تعليمهم أو جنسيتهم، فإن الثقة ستتآكل.

وعندما تتراجع الثقة، يضعف الوعد بأن يكون الذكاء الاصطناعي قوة ديمقراطية إيجابية.

نتائج MIT ليست إدانة للتقنية بحد ذاتها، بل تذكير بأن نماذج اللغة الكبيرة هي أنظمة اجتماعية-تقنية تتشكل بفعل البيانات والحوافز والسياسات.

التكنولوجيا لا تعمل في فراغ.

والعدالة لا تنشأ تلقائياً.

بل يجب تصميمها، وقياسها، وتطبيقها بوعي ومسؤولية.